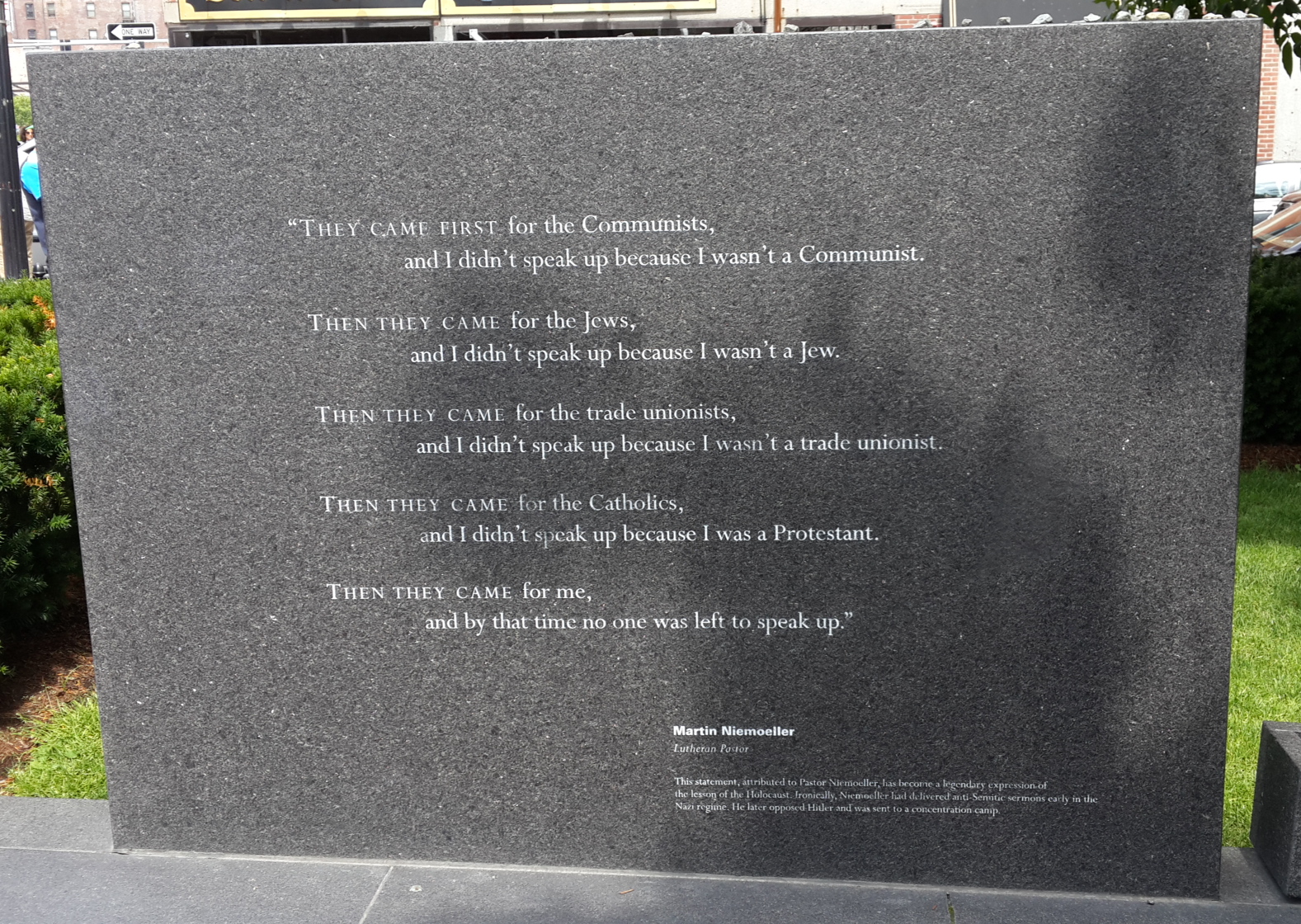

Eg startar innlegget med eit dikt frå ei dyster tid i forrige århundre. Det illustrerer kva som skjer når ein apatisk aksepterer at små bitar av vårt handlingsrom blir fjerna. Brått er dagen komen der det er deg dei er på jakt etter:

I ein rettsstat er ein uskuldig inntil det motsette er prova. Så lenge ein er uskuldig har ein ikkje rett til å overvake ditt daglege liv. Dersom politiet får mistanke om at du driv på med noko kriminelt, kan dei gå til ein domstol med sine førebelse bevis eller indikasjonar. Domstolen kan avvise eller gi politiet rett til å ransake og eventuelt overvake deg for å samle bevis til ei eventuell rettsak der ein domstol tek stilling til om du du er strafferettsleg skuldig eller uskuldig etter anklage. Det er stor fare for at denne måten no vert undergreven og vi vil kome til å leve i eit overvakingssamfunn der det minste feiltrinn blir prompte slått ned på og straffa.

Først vil eg berra ha sagt at at mishandling og misbruk av barn er forkastleg og ulovleg. Slikt må straffast, men samtidig er eg sterkt ueinig i framgangsmåtar som no er på bordet frå politikarar og verksemder. Poltikarane ønskjer seg bakdører i sikker kommunikasjon. Apple legg til rette for å skanne alle dine foto du har lagra på utstyret ditt.

At tilbydarar har bruksvilkår for sine skytenester er greitt. Dei er i sin fulle rett til å setje rammer for kva som er akseptabelt i iCloud osv. I vinter hadde vi tenesta Parler som gjentekne gonger braut vilkåra til Amazon Web Services og vart utestengt frå deira plattform.

Eg har hatt nettsider sidan før tusenårsskiftet. For 14 år sidan flytta eg innhaldet mitt på ei Microsoft-teneste, som seinare vart lagt ned slik at eg enda opp på WordPress. Eit av bileta, som aldri hadde vore eit problem for norsk tenesteleverandør, vart identifisert av ei algoritme hos Microsoft til å vere i strid med vilkåra deira og eg vart beden om å fjerne det.

Det som er er spesielt med Apple er at dei vil flytte overvakinga frå skya og ned til dine einingar – Apple MacBook, iPad, iPhone, Watch osv., https://www.apple.com/child-safety/:

Apple’s method of detecting known CSAM* is designed with user privacy in mind. Instead of scanning images in the cloud, the system performs on-device matching using a database of known CSAM image hashes provided by NCMEC and other child safety organizations. Apple further transforms this database into an unreadable set of hashes that is securely stored on users’ devices.

* Child Sexual Abuse Material

I motsetning til Parler og eg, som hadde lagt offentlige tilgjengeleg informasjon på tenester som streid mot vilkår, vil Apple skanne dine private bilete som ligg på dine private einingar. Bileta blir prosessert lokalt av ei avansert algoritme som genererer ein matematisk verdi, også kalla hash, av bilete. Verdien blir samanlikna verdiar generert frå kjent «problematisk media»:

The system, called neuralMatch, will “proactively alert a team of human reviewers if it believes illegal imagery is detected, who would then contact law enforcement if the material can be verified,” the Financial Times said. neuralMatch, which was trained using 200,000 images from the National Center for Missing & Exploited Children, will roll out first in the US. Photos will be hashed and compared with a database of known images of child sexual abuse.

“According to people briefed on the plans, every photo uploaded to iCloud in the US will be given a ‘safety voucher,’ saying whether it is suspect or not,” the Financial Times said. “Once a certain number of photos are marked as suspect, Apple will enable all the suspect photos to be decrypted and, if apparently illegal, passed on to the relevant authorities.”

The Verge

So bra – tommel opp, seier du. Vent, seier eg. Mitt bilete på ei nettsideteneste frå Microsoft vart fanga opp av ei algoritme som mellom anna baserte seg på andel hudfargar i bilete. Sjølve bilete viste ein barnerygg, hardt angrepen av vannkoppar i lindrande bad, utan at ein kunne identifisere kven dette var. Algoritmane til Apple vil eg tru har kome mykje lengre enn dei ein hadde for over 10 år sidan, men her er det prinsippet eg er i mot. Det blir berre heilt feil å sei at alle er skuldige, ergo må vi overvåke dei for å prove at dei er uskuldige.

Vi tek masse bilete med telefonane sine. Småbarnsfamiliar har bilete av barn med og utan klede. Poden leikar naken i strandkanten eller ved oppblåsbare bassenget. Du tek bilete når du badar dei, steller dei eller når dei er sjuke og fulle av vannkoppar. Nokon sender du til besteforeldre og dine vener, men det meste er held du privat for deg. Sjølv om du ikkje brukar Apple sin skyteneste iCloud, vil Apple kontrollere alle bileta mot problematisk materiale. Eg har sett litt på den tekniske overordna skildringa:

The main purpose of the hash is to ensure that identical and visually similar images result in the same hash, and images that are different from one another result in different hashes. For example, an image that has been slightly cropped or resized should be considered identical to its original and have the same hash.

Apple

Legg merke til at ein går på visuelle i bilete. Ein svart/kvitt-versjon av same bilete generer tilsvarande hash. I tillegg vil same bilete litt skore til eller med endra oppløysing få same hash.

I dokumentet eg lenka til er det forklart korleis ein kjem fram til det, men forklaringa «går meg hus forbi». Slik eg ser det vil det vere ei måling av forhold mellom punkt eller former i bilete uavhengig av fargar. Forholdet vil eksistere sjølv om ein endrar oppløysing på bilete og dersom ein har eit stort nok sett med slike målepunkt, gjer det ikkje noko om ytterkantar av bilete er tilpassa, f. eks. 16:9 kontra 4:3-storleik.

Det næraste eg kan tenkje med er at det blir noko tilsvarande ansiktsgjenkjenninga på iPhone, tilrettelagt for bilete. Med identiske tvillingar har eg god erfaring med gjenkjenningssystem anten dei kjem frå Apple, Microsoft eller blir nytta i passkontrollen. 4 av 4 system vi har testa har feila på å skilje tvillingane frå kvarandre. Systema er ikkje i tvil, dei ser same person uavhengig av kven av tvillingane dei ser på. Tenk på det når dine bilete skal analyserast.

Denne gongen vil dei ha kontroll på bileta dine, neste gong går dei etter meiningane dine. Dette er ein autokrats våte draum. Eg kan ikkje fatte at Apple, som ein tilsynelatande fanebærar av personvernet i vanskelege tider, har lete seg forlede til å utarbeide noko slikt.